两个20T硬盘做raid

先说结论

不推荐这样在系统层面作raid,因为性能发挥不出来。以下所有都是自娱自乐,干活还得是在bios层面先做好raid,系统直接识别成一个盘,性能才能发挥出来。

准备工作

识别

拿到硬盘以后,首先还是要识别一下硬盘。

1 | lsblk |

一般可以看见多了一个 sda 或者sdb 的磁盘,我的两块磁盘都是20T的比较大。

创建分区

依次对两个磁盘创建分区

1 | sudo apt install gdisk # 这里不用fdisk了,创建新的 GPT 分区表 所以用gdisk(2T分界线)。 |

格式化分区

依次对两个磁盘的新分区格式化

1 | # 16T单个文件分界线,大盘推荐 xfs 格式。 |

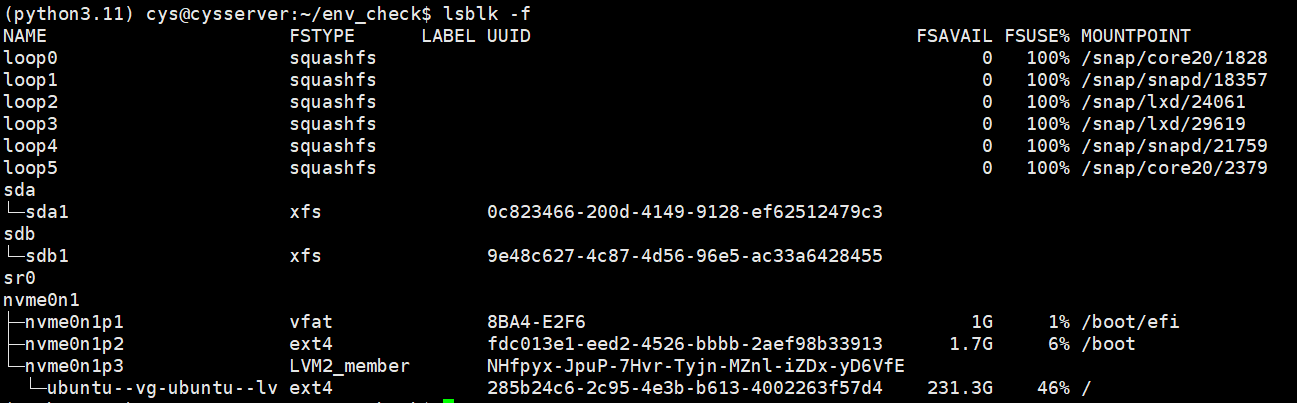

此时 lsblk -f 可见 sda磁盘的下面多了一个 sda1的分区,而且格式为 xfs;sdb磁盘的下面多了一个 sdb1的分区,而且格式为 xfs。

raid

制作raid设备

在你创建 RAID 阵列时,新的 RAID 阵列会覆盖原有的数据,这样所有多个磁盘上的数据都会被清理干净。

(一)选择制作做raid1

20T 和20T作 raid1是一个备份,可以防止数据丢失,但是空间只用的上20T了。

1 | sudo apt update |

(二)选择制作做raid0

20T 和20T作 raid0是纯粹的扩大空间,空间40T了。

1 | sudo apt update |

(三)选择制作做raid5

1 | sudo apt update |

格式化raid设备

1 | sudo mkfs.xfs /dev/md0 |

创建挂载点

1 | sudo mkdir -p /data_raid |

1、选择临时挂载

1 | sudo mount /dev/md0 /data_raid |

2、选择永久性挂载

1 | sudo blkid /dev/md0 # 获取raid设备的uuid。 |

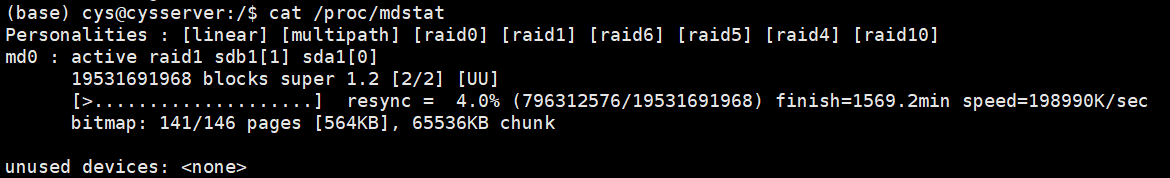

检查 RAID 阵列的状态

1 | cat /proc/mdstat # 如果创建成功,会看到 /dev/md0(raid设备) 的信息 |

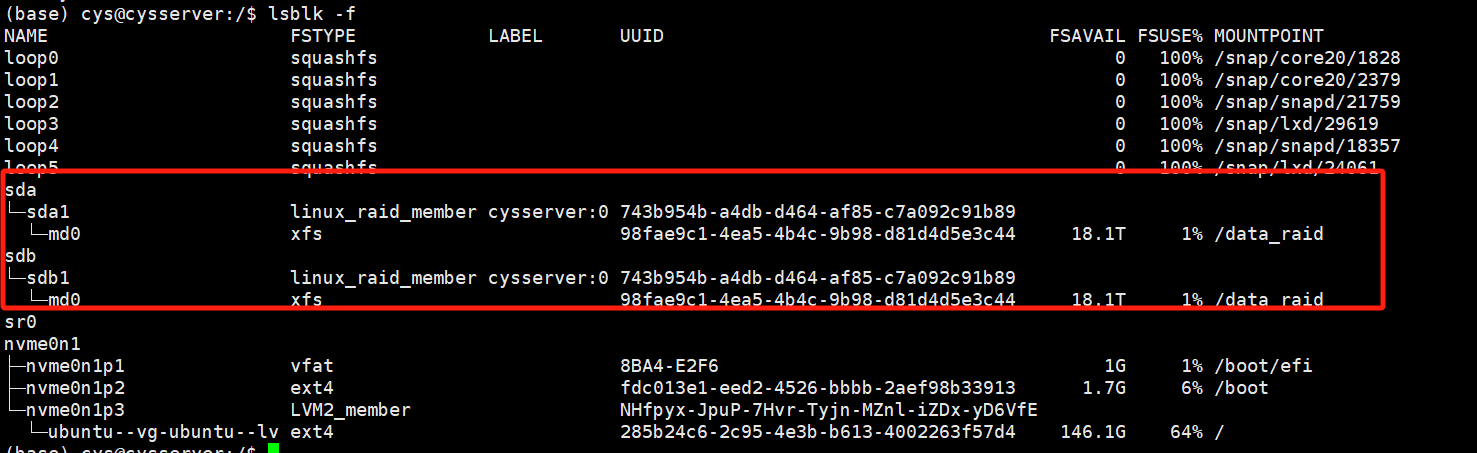

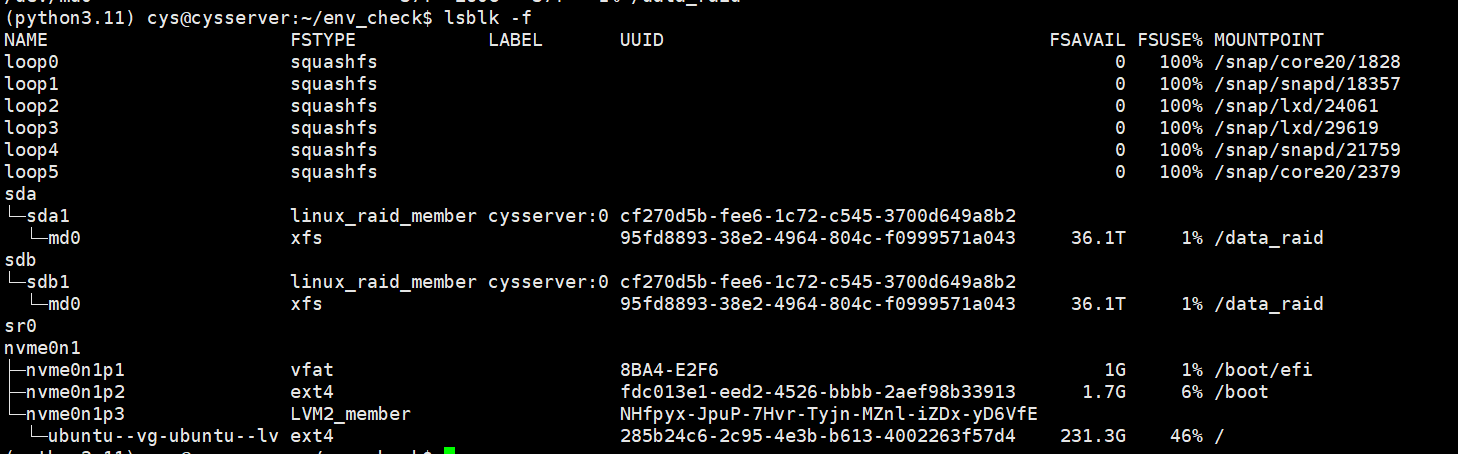

1 | lsblk -f |

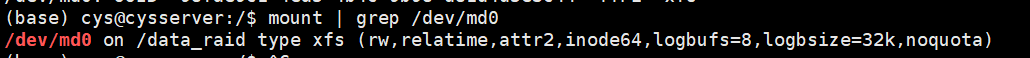

1 | sudo blkid /dev/md0 # 查看挂载情况 |

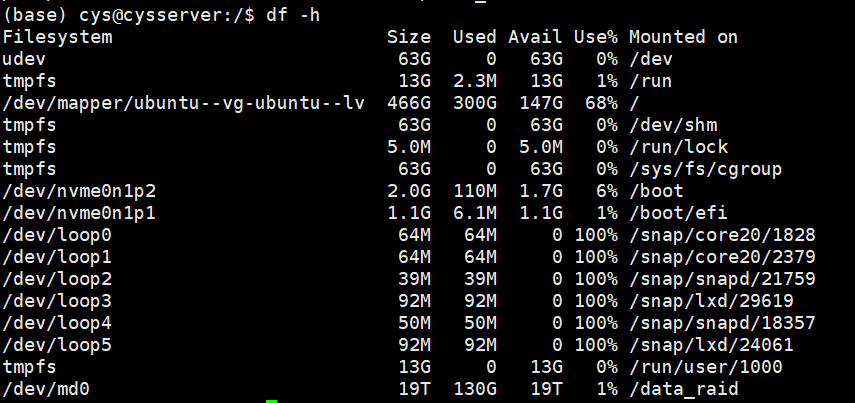

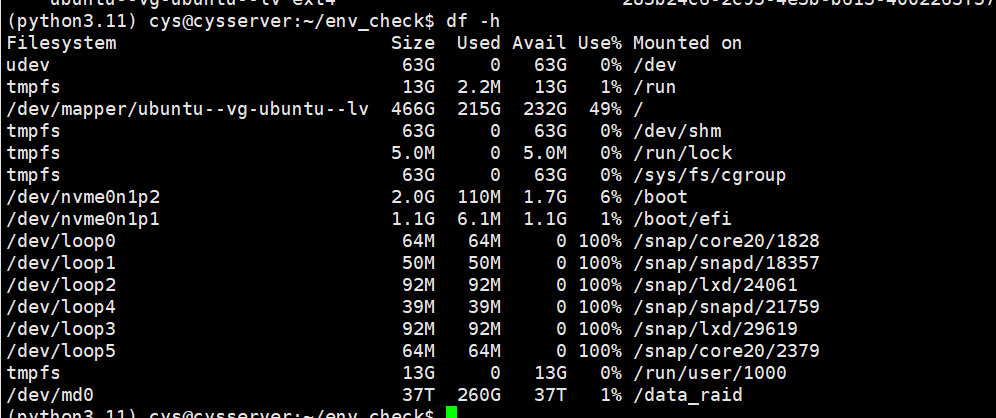

1 | df -h |

删除raid设备

1 | # 看看 有没有md0 |

期间可能遇到的问题

遇到 wrong fs type, bad option, bad superblock on /dev/vdc1 等等类似的 xfs 挂载失败 的问题,

解决方法

参考:

中间出处: https://armstrong.viyf.org/articles/2023/08/mount-wrong-fs-type-bad-option-bad-superblock.shtml

原因:XFS 为了防止同一个文件系统被多次挂载,在格式化硬盘并创建文件系统时会给文件系统打上 UUID。挂载分区时,XFS 检测到当前挂载了相同 UUID 的分区,就会拒绝执行挂载。

结论,解决方法就是 不用uuid挂载。

1 | # 临时挂载 |